Multikolinearitas merupakan suatu kondisi dalam analisis regresi di mana terdapat korelasi linear yang tinggi antara dua atau lebih variabel prediktor (variabel independen). Kondisi ini dapat mengganggu interpretasi koefisien regresi dan mengurangi keandalan model statistik. Akibatnya, sulit untuk mengisolasi efek masing-masing variabel prediktor terhadap variabel dependen. Deteksi dan penanganan multikolinearitas sangat penting untuk membangun model regresi yang valid dan handal.

Sebagai contoh, bayangkan sebuah model regresi yang memprediksi harga rumah berdasarkan luas tanah, luas bangunan, dan jumlah kamar. Luas tanah dan luas bangunan kemungkinan besar berkorelasi tinggi karena rumah yang lebih besar cenderung dibangun di atas tanah yang lebih luas. Korelasi ini dapat menyebabkan multikolinearitas. Contoh lain adalah model yang memprediksi penjualan produk berdasarkan biaya iklan di televisi, radio, dan media cetak. Jika perusahaan cenderung meningkatkan pengeluaran di semua platform iklan secara bersamaan, maka variabel-variabel ini akan berkorelasi dan menimbulkan multikolinearitas.

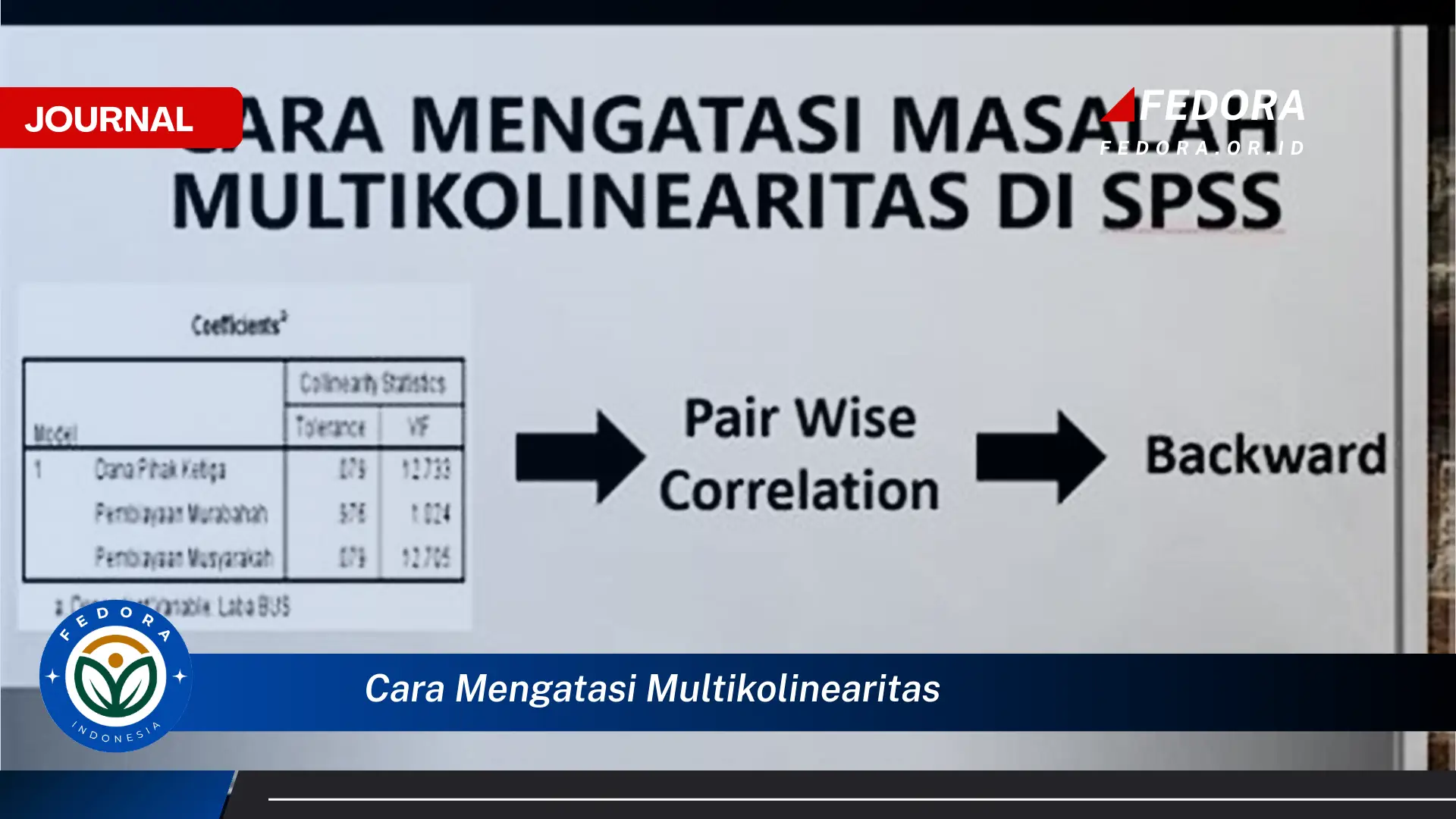

Langkah-langkah Mengatasi Multikolinearitas

- Identifikasi Multikolinearitas: Hitung Variance Inflation Factor (VIF) untuk setiap variabel prediktor. VIF di atas 5 atau 10 umumnya mengindikasikan adanya multikolinearitas. Selain VIF, matriks korelasi antar variabel prediktor juga dapat digunakan sebagai indikasi awal. Perhatikan nilai korelasi yang mendekati 1 atau -1, yang menunjukkan korelasi linear yang kuat.

- Hapus Variabel: Jika memungkinkan, hapus salah satu variabel prediktor yang berkorelasi tinggi. Pilih variabel yang secara teoritis kurang penting atau yang memiliki VIF tertinggi. Penghapusan variabel harus dipertimbangkan dengan hati-hati dan didasarkan pada pemahaman tentang konteks penelitian.

- Gabungkan Variabel: Buat variabel komposit dengan menggabungkan variabel-variabel yang berkorelasi tinggi. Misalnya, jika terdapat multikolinearitas antara luas tanah dan luas bangunan, dapat dibentuk variabel baru “luas properti total”. Metode ini dapat mempertahankan informasi yang terkandung dalam variabel asli sambil mengurangi multikolinearitas.

- Regularisasi: Teknik regularisasi seperti Ridge Regression dan Lasso Regression dapat membantu mengurangi dampak multikolinearitas. Metode ini menambahkan penalti pada koefisien regresi, yang mengecilkan koefisien dan mengurangi varians model.

Tujuan dari langkah-langkah ini adalah untuk menghasilkan model regresi yang lebih stabil, dengan koefisien yang lebih mudah diinterpretasi dan prediksi yang lebih akurat. Model yang bebas dari multikolinearitas akan memberikan gambaran yang lebih jelas tentang hubungan antara variabel prediktor dan variabel dependen.

Poin-Poin Penting

| Poin | Detail |

|---|---|

| Memahami Konteks Data | Pemahaman yang mendalam tentang data dan hubungan antar variabel sangat penting. Ini membantu dalam mengidentifikasi variabel yang secara logis berkorelasi dan memilih metode penanganan yang tepat. Analisis yang cermat terhadap konteks data dapat mencegah pengambilan keputusan yang salah berdasarkan hasil regresi yang terdistorsi oleh multikolinearitas. Konteks data juga membantu dalam interpretasi hasil setelah multikolinearitas diatasi. |

| Penggunaan VIF | Variance Inflation Factor (VIF) adalah metrik kunci untuk mendeteksi multikolinearitas. Nilai VIF yang tinggi menunjukkan adanya korelasi linear yang kuat antara variabel prediktor. Memahami cara menghitung dan menginterpretasikan VIF sangat penting untuk mengidentifikasi dan mengatasi masalah multikolinearitas secara efektif. VIF memberikan informasi kuantitatif tentang seberapa besar varians koefisien regresi meningkat karena multikolinearitas. |

| Pertimbangan Teoritis | Keputusan untuk menghapus atau menggabungkan variabel tidak boleh hanya berdasarkan statistik, tetapi juga pertimbangan teoritis. Variabel yang penting secara teoritis harus dipertahankan meskipun berkorelasi tinggi dengan variabel lain. Keputusan yang didasarkan pada pertimbangan teoritis akan menghasilkan model yang lebih bermakna dan dapat diinterpretasikan dengan lebih baik. Hal ini memastikan bahwa model tetap relevan dengan pertanyaan penelitian yang diajukan. |

| Penggunaan Teknik Regularisasi | Teknik regularisasi seperti Ridge Regression dan Lasso Regression menawarkan solusi yang efektif untuk mengatasi multikolinearitas. Metode ini menambahkan penalti pada koefisien regresi, yang mengurangi dampak variabel yang berkorelasi tinggi. Penggunaan teknik regularisasi dapat meningkatkan stabilitas dan prediktifitas model regresi. Pilihan metode regularisasi yang tepat tergantung pada karakteristik data dan tujuan analisis. |

| Evaluasi Model | Setelah mengatasi multikolinearitas, penting untuk mengevaluasi kembali kinerja model. Periksa kembali nilai R-squared, kesalahan standar koefisien, dan signifikansi statistik. Pastikan bahwa model yang dihasilkan lebih stabil dan memiliki kemampuan prediksi yang lebih baik. Evaluasi model yang komprehensif memastikan bahwa langkah-langkah yang diambil untuk mengatasi multikolinearitas telah berhasil. |

| Interpretasi Koefisien | Setelah multikolinearitas diatasi, koefisien regresi dapat diinterpretasikan dengan lebih percaya diri. Koefisien tersebut mencerminkan pengaruh masing-masing variabel prediktor terhadap variabel dependen secara lebih akurat. Interpretasi koefisien yang benar sangat penting untuk memahami hubungan antar variabel dan menarik kesimpulan yang valid dari analisis regresi. Interpretasi yang akurat memungkinkan pengambilan keputusan yang lebih tepat berdasarkan hasil analisis. |

| Data Transformasi | Dalam beberapa kasus, transformasi data seperti standardisasi atau normalisasi dapat membantu mengurangi multikolinearitas. Transformasi data dapat mengubah skala variabel dan mengurangi korelasi antar variabel. Namun, penting untuk mempertimbangkan dampak transformasi data terhadap interpretasi hasil. Transformasi data harus dipilih dengan hati-hati dan didasarkan pada karakteristik data. |

| Konsultasi dengan Ahli Statistik | Jika menghadapi kesulitan dalam mengatasi multikolinearitas, disarankan untuk berkonsultasi dengan ahli statistik. Seorang ahli statistik dapat memberikan panduan dan saran yang tepat berdasarkan karakteristik data dan tujuan analisis. Konsultasi dengan ahli statistik dapat membantu menghindari kesalahan dan memastikan analisis yang valid dan handal. Ahli statistik dapat membantu memilih metode yang paling tepat dan menginterpretasikan hasil dengan benar. |

Tips dan Detail

- Visualisasi Data: Plot scatter plot antara variabel prediktor untuk mengidentifikasi korelasi secara visual. Scatter plot dapat memberikan gambaran awal tentang hubungan antar variabel dan membantu mengidentifikasi pola korelasi yang kompleks. Visualisasi data memudahkan identifikasi potensi multikolinearitas.

- Penggunaan Software Statistik: Manfaatkan software statistik seperti R, Python, atau SPSS untuk menghitung VIF dan melakukan analisis regresi. Software statistik menyediakan alat dan fungsi yang memudahkan analisis data dan interpretasi hasil. Penggunaan software statistik juga meningkatkan efisiensi dan akurasi analisis. Software statistik memungkinkan otomatisasi proses perhitungan dan visualisasi data.

- Dokumentasi: Dokumentasikan setiap langkah yang diambil dalam mengatasi multikolinearitas, termasuk metode yang digunakan dan alasan di balik keputusan tersebut. Dokumentasi yang baik memastikan transparansi dan reproduksibilitas analisis. Dokumentasi yang jelas juga memudahkan interpretasi hasil dan komunikasi dengan pihak lain. Dokumentasi yang lengkap membantu dalam melacak perubahan dan revisi yang dilakukan selama proses analisis.

Dokumentasi yang baik sangat penting dalam setiap analisis statistik, termasuk dalam mengatasi multikolinearitas. Dokumentasi harus mencakup metode yang digunakan untuk mendeteksi multikolinearitas, seperti perhitungan VIF atau analisis matriks korelasi. Selain itu, dokumentasi juga harus menjelaskan langkah-langkah yang diambil untuk mengatasi multikolinearitas, seperti penghapusan variabel, penggabungan variabel, atau penggunaan teknik regularisasi. Alasan di balik setiap keputusan harus dijelaskan secara rinci. Dokumentasi yang baik memastikan bahwa analisis dapat direproduksi dan diinterpretasikan dengan benar oleh orang lain.

Visualisasi data melalui scatter plot memungkinkan peneliti untuk melihat secara langsung hubungan antara variabel prediktor. Pola linear yang kuat pada scatter plot menunjukkan adanya korelasi yang tinggi, yang dapat mengindikasikan multikolinearitas. Selain itu, scatter plot juga dapat mengungkap pola non-linear yang mungkin tidak terdeteksi oleh metode statistik lainnya. Dengan memahami pola hubungan antar variabel, peneliti dapat membuat keputusan yang lebih tepat dalam mengatasi multikolinearitas.

Software statistik seperti R, Python, dan SPSS menyediakan fungsi-fungsi khusus untuk menghitung VIF dan melakukan analisis regresi. Dengan menggunakan software statistik, peneliti dapat dengan mudah menghitung VIF untuk setiap variabel prediktor dan mengidentifikasi variabel yang berkorelasi tinggi. Selain itu, software statistik juga menyediakan berbagai metode untuk mengatasi multikolinearitas, seperti penghapusan variabel, penggabungan variabel, dan teknik regularisasi. Penggunaan software statistik memungkinkan peneliti untuk melakukan analisis yang lebih komprehensif dan efisien.

Multikolinearitas dapat menyebabkan koefisien regresi menjadi tidak stabil dan sulit diinterpretasi. Koefisien regresi menunjukkan besarnya pengaruh variabel prediktor terhadap variabel dependen. Ketika multikolinearitas terjadi, koefisien regresi menjadi sensitif terhadap perubahan kecil dalam data, sehingga sulit untuk menentukan pengaruh sebenarnya dari setiap variabel prediktor. Akibatnya, kesimpulan yang ditarik dari model regresi dapat menyesatkan.

Mendeteksi multikolinearitas sejak dini sangat penting untuk membangun model regresi yang valid. Beberapa metode yang umum digunakan untuk mendeteksi multikolinearitas antara lain menghitung Variance Inflation Factor (VIF) dan menganalisis matriks korelasi. VIF mengukur seberapa besar varians koefisien regresi meningkat karena multikolinearitas. Nilai VIF yang tinggi menunjukkan adanya multikolinearitas. Matriks korelasi menunjukkan korelasi antar variabel prediktor. Korelasi yang tinggi antara dua atau lebih variabel prediktor dapat mengindikasikan multikolinearitas.

Salah satu cara untuk mengatasi multikolinearitas adalah dengan menghapus salah satu variabel prediktor yang berkorelasi tinggi. Variabel yang dihapus sebaiknya variabel yang secara teoritis kurang penting atau yang memiliki VIF tertinggi. Namun, penghapusan variabel harus dipertimbangkan dengan hati-hati karena dapat menghilangkan informasi penting dari model. Penting untuk memastikan bahwa penghapusan variabel tidak mengubah interpretasi model secara signifikan.

Metode lain untuk mengatasi multikolinearitas adalah dengan menggabungkan variabel-variabel yang berkorelasi tinggi menjadi variabel komposit. Variabel komposit dibentuk dengan menggabungkan variabel-variabel asli menjadi satu variabel baru. Misalnya, jika terdapat multikolinearitas antara usia dan pendapatan, dapat dibentuk variabel komposit “status sosial ekonomi”. Metode ini dapat mempertahankan informasi yang terkandung dalam variabel asli sambil mengurangi multikolinearitas.

Teknik regularisasi seperti Ridge Regression dan Lasso Regression juga dapat digunakan untuk mengatasi multikolinearitas. Teknik regularisasi menambahkan penalti pada koefisien regresi, yang mengecilkan koefisien dan mengurangi varians model. Metode ini efektif dalam mengurangi dampak multikolinearitas tanpa harus menghapus variabel. Pilihan metode regularisasi yang tepat tergantung pada karakteristik data dan tujuan analisis.

Setelah mengatasi multikolinearitas, penting untuk mengevaluasi kembali kinerja model. Periksa kembali nilai R-squared, kesalahan standar koefisien, dan signifikansi statistik. Pastikan bahwa model yang dihasilkan lebih stabil dan memiliki kemampuan prediksi yang lebih baik. Evaluasi model yang cermat memastikan bahwa langkah-langkah yang diambil untuk mengatasi multikolinearitas telah berhasil.

Multikolinearitas adalah isu penting dalam analisis regresi yang dapat mempengaruhi validitas dan keandalan model. Dengan memahami penyebab, dampak, dan cara mengatasi multikolinearitas, peneliti dapat membangun model regresi yang lebih akurat dan dapat diinterpretasikan dengan lebih baik. Penggunaan metode yang tepat untuk mendeteksi dan mengatasi multikolinearitas sangat penting untuk menghasilkan hasil analisis yang valid dan dapat diandalkan.

Pemahaman yang mendalam tentang multikolinearitas dan penerapan teknik yang tepat untuk mengatasinya merupakan langkah penting dalam analisis regresi. Dengan mengatasi multikolinearitas, peneliti dapat membangun model yang lebih robust dan menghasilkan kesimpulan yang lebih akurat. Hal ini pada akhirnya akan meningkatkan kualitas dan kredibilitas penelitian.

FAQ

Pertanyaan dari Budi: Bagaimana cara menentukan ambang batas VIF yang tepat untuk mengindikasikan multikolinearitas?

Jawaban dari Ikmah (Ahli Statistik): Tidak ada ambang batas VIF yang baku. Secara umum, VIF di atas 5 atau 10 sering digunakan sebagai indikasi adanya multikolinearitas. Namun, keputusan akhir harus berdasarkan konteks data dan tujuan analisis. VIF yang lebih rendah dari 5 juga bisa bermasalah jika menyebabkan ketidakstabilan koefisien regresi.

Pertanyaan dari Ani: Apakah selalu perlu mengatasi multikolinearitas?

Jawaban dari Wiki (Ahli Statistik): Tidak selalu. Jika tujuan analisis hanya untuk prediksi dan multikolinearitas tidak terlalu parah, maka mungkin tidak perlu diatasi. Namun, jika tujuannya adalah untuk menginterpretasi koefisien regresi, maka multikolinearitas harus diatasi.

Pertanyaan dari Dedi: Apa yang terjadi jika multikolinearitas diabaikan?

Jawaban dari Ikmah (Ahli Statistik): Mengabaikan multikolinearitas dapat menyebabkan koefisien regresi menjadi tidak stabil dan sulit diinterpretasi. Hal ini dapat mengarah pada kesimpulan yang salah tentang hubungan antar variabel.

Pertanyaan dari Siti: Metode mana yang paling efektif untuk mengatasi multikolinearitas?

Jawaban dari Wiki (Ahli Statistik): Tidak ada metode yang paling efektif untuk semua situasi. Pilihan metode terbaik tergantung pada karakteristik data, tujuan analisis, dan pertimbangan teoritis. Terkadang, kombinasi beberapa metode diperlukan.